研究人员在一项调查中发现,人工智能招聘工具未能起到减少偏见或提升多样性的作用。

责任编辑:张燕妮 来源: 至顶网

来自剑桥大学的研究人员在《哲学与技术》(Philosophy & Technology)期刊上称:“人们对于能解决面试偏见等问题的新方法越来越感兴趣。”AI的实际应用正愈发普遍,但在通过视频或应用指标遴选求职者方面仍处于“伪科学”的水平。

曾有人力资源专业机构向媒体放话,称AI技术有望对抗偏见。

研究发现,2020年一项针对500名人力资源专业人士的跨国调查表明,近四分之一的从业者正在利用AI“以自动化方式选拔人才。”但这种减少偏见的探索似乎并未奏效,剑桥大学性别研究中心博士后研究员Kerry Mackereth在采访中表示,这事完全就是在“扯淡”。

她解释道:“这些工具无法通过训练获得单纯识别工作相关特征的能力,也不能从招聘过程中剔除性别和种族因素。这是因为人类总认为,一位员工是否优秀会不可避免地与其性别、特征和种族存在内在关联。”

也有研究指出,一些公司还发现这些工具本身也存在问题。2018年,亚马逊就宣布放弃开发AI驱动型招聘引擎,因为发现其会从简历中检测性别并歧视女性求职者。

“现代颅相学”

研究人员还特别关注那些能够“分析候选人言语与肢体动作细节”的工具,据称这些细微要素也能体现对象是否符合特定职位的要求。

研究合作者Eleanor Drage博士则坦言,这类视频与图像分析技术“没有科学依据”,并将其斥为“现代颅相学”——即依靠颅骨形状推断性格与智力的虚假理论。

她强调:“他们认为可以通过面部观察了解对方的性格。这种想法就跟测试工具一样根本不靠谱。AI没办法‘透过’面孔看到真实的内在。”

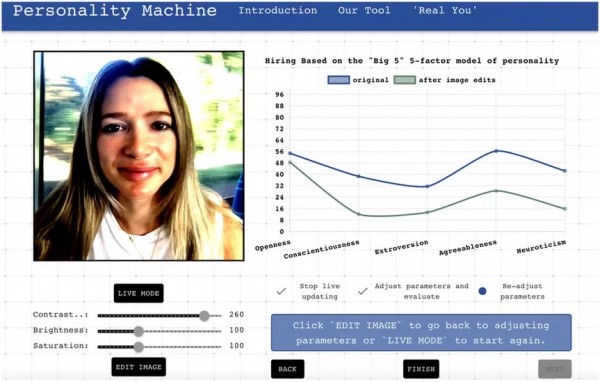

剑桥工具截屏

研究人员们还与六名计算机科学专业的学生一道,构建起自己的简化版AI招聘工具,基于所谓“五大”人格特征对候选者照片进行评分:

平易近人型

外向型

开放型

负责型

神经质型

但最终评级还是会受到种种非相关变量的影响。

Drage博士写道:“在使用这些工具时,可以看到只要调整图像的对比度/亮度/饱和度,AI得出的性格结论就会发生变化。”

The Register指出,其他调查也得到了类似的结论。

德国一家公共广播公司甚至发现,在视频中佩戴眼镜或头巾,也会影响到候选者的最终得分。

英国特许人事与发展协会(Chartered Institute of Personnel and Development)的Hayfa Mohdzaini指出,他们的研究表明只有8%的企业雇主会使用AI技术来筛选求职人才。

“AI确实可以加大候选人才库的整体规模,借此帮助组织提升多样性水平——但如果规则和训练数据不完整或不准确,也有可能错失很多优秀的求职者。”

她总结称:“目前,用于对候选者言语和肢体语言进行分析的AI软件尚处于起步阶段,其中当然蕴藏着巨大的机会,但也有风险与之伴生。”

免责声明:本文版权归原作者所有,钱大人登载此文出于传递更多信息之目的,并不意味着赞同其观点或证实其描述。文章内容仅供参考,不构成投资建议。投资者据此操作,风险自担。此文如侵犯到您的合法权益,请联系我们。

文章评论

0条